作者:毛烁

过去几年,外界理解NVIDIA,往往从 GPU、CUDA、训练集群这些关键词切入。但在今年,这套解释框架已经发生了变化。

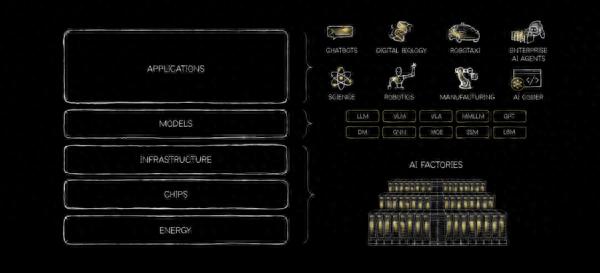

在GTC 2026开始前,老黄发布了一篇“AI五层蛋糕”的署名文章。在“五层蛋糕”的体系中,老黄重新给出了AI的坐标系——最底层是能源层,负责提供稳定、可调度的实时电力;往上是芯片层,将能量高效转化为计算;再往上是基础设施层,把成千上万的处理器组织成一个可调度的整体,也就是“AI工厂”;其上是模型层,承载语言、物理、生物、化学等基础模型;最上层才是应用层,完成最终的价值变现。

正因为目标发生了迁移,所以对于今年的GTC 2026,我理解NVIDIA在表达其围绕算力生产与交付方式的系统性逻辑。沿着“五层蛋糕”展开,可以看到NVIDIA的自我定位开始转向为AI工厂的全栈架构设计者。

01 “五层蛋糕”是理解GTC 2026的入口

如果要为GTC 2026找一个理解的入口,“五层蛋糕”是不容易走偏的一条。

老黄在署名文章里先给了一个前提判断:计算范式已经发生变化。过去的软件是预制逻辑,数据被整理为结构化表格,通过精确查询完成调用;而今天的 AI,处理的是非结构化信息,基于上下文与意图进行推理,并实时生成结果。既然“智能”不再是预先写好的代码,那么支撑它的整套计算体系,也就不可能沿用旧架构。

在这个前提下,他给出了“五层蛋糕”框架。

用这一框架看GTC 2026上NVIDIA的发布,就不难看出,这些分散的产品线,是围绕同一目标展开的——在功率受限成为常态的前提下,将数据中心转化为高吞吐、低时延、可持续运行的“token生产系统”。

由此带来的变化,是评价体系的迁移。行业关注重点从单卡性能、互联带宽与集群规模,转向单位功率下的token产出、时延稳定性与系统利用率。

沿着这一逻辑,电力接入、液冷系统、机房形态、施工与部署节奏、仿真验证,再到模型训练与推理调度等原本分散的要素开始被统一纳入同一设计框架。这种从基础设施到上层应用的整体协同,被NVIDIA称为extreme codesign(深度协同设计),本质上是对全链路进行统一优化。

这一方向在Rubin平台早期阶段已经有所体现。当时强调的是系统内部六大核心芯片的协同设计:Vera CPU、Rubin GPU、NVLink 6 Switch、ConnectX-9 SuperNIC、BlueField-4 DPU、Spectrum-6以太网交换机,解决的是计算系统内部的组织方式。而在GTC 2026上,这一协同被进一步外延,与DSX、Dynamo、STX、Nemotron等软件与模型体系结合,整体纳入AI工厂的统一框架之中。

因此,“五层蛋糕”的意义,就成为了“建立统一的尺度”。

02 能源层:AI工厂的“第一性约束”,落到了每瓦token的产出

“五层蛋糕”中真正决定下限的一层,其实是能源。

老黄在署名文章里的表述非常清楚:每一个token的生成,本质上都是电子流动、热量管理以及能量向计算转化的过程。在这一层之下,并不存在进一步的抽象层。这一判断的意义在于,把AI重新放回到一个工业系统之中来理解,不再只是模型、参数与评测指标,而是回到供电、散热与工程实现这些更基础、也更刚性的维度。

从这个视角看,未来几年真正拉开差距的,很可能不是谁的模型更大,而是谁能够更高效地使用“电”。

而这种能力,取决于电网接入、冷却方式、建设周期,以及设备交付等一整套条件,最终体现为单位时间内可持续输出的计算能力。

在GTC 2026上,NVIDIA给出的应对思路是向系统层发力。

一个比较直观的变化,是机架级形态正在围绕液冷被重新定义。Vera Rubin系统已经实现了100%液冷,并引入高温水冷设计,一方面压缩部署周期,另一方面把原本消耗在制冷上的能量尽可能让渡给计算。

这是在重新分配数据中心内部的能量结构。

但更值得注意的,是另一条更偏“运营侧”的路径。NVIDIA将“AI工厂”当作了持续运行、持续调整的系统来对待。

围绕这一点,NVIDIA在GTC 2026上推出了NVIDIA Omniverse DSX Blueprint,以及Vera Rubin DSX AI Factory参考设计,把tokens per watt、time to first production(每瓦Token 数 / 单位功耗Token吞吐量),以及系统韧性等指标放在同一套框架下,同时将机架、电气、热管理、网络乃至运行策略,也放进了同一个设计与优化系统中。

生态的构成也印证了这一点。在DSX这套体系中,不同合作伙伴的角色,对应AI工厂从设计到运行的不同环节。Cadence、Dassault Systèmes、PTC、Siemens这类公司,解决的是“设计”的问题,NVIDIA用AI加持他们的建模与仿真能力,把机房结构、供配电路径、气流组织等复杂系统,先在数字世界里完整推演一遍,提前看到性能与能效的结果。

而Trane、Vertiv、Schneider Electric则对应“怎么建出来”。冷却系统如何落地、供电系统如何部署、整套基础设施如何稳定运行,这一层决定的是AI工厂能否真正投入使用。

再往后一层,Phaidra、Emerald AI这类合作伙伴处理的是,“建成之后如何持续跑得更好”。其通过实时数据去调整功率分配、冷却策略和负载节奏,让系统在不同工况下都尽量接近最优状态。

把这三部分连在一起看,就会发现DSX想做的事情,是把“设计—建设—运行”这三段彼此割裂的流程收拢到同一套体系中。这样一来,很多原本只能在建成之后再慢慢试错的问题,可以提前在设计阶段被验证,而运行阶段的优化经验,也可以反过来修正设计本身。。

在这一框架下,NVIDIA发布DSX Sim、DSXMax-Q、DSXFlex等软件的价值,就是在数字孪生环境中,把功率、冷却与网络耦合起来,通过持续调优去实现更高效的运行状态。

03 芯片层:把算力变成可交付的生产单元

顺着“五层蛋糕”去理解,芯片层的意义就是把电力高效转化为计算能力的任务,其决定AI能扩到多大规模,也决定智能能否进入更广泛、更低成本的应用场景。

从更新的技术和产品中,也能看出这层意思。

1、Vera Rubin NVL72:机架成为芯片层的基本交付单元

Vera Rubin NVL72集成了72颗Rubin GPU,36颗Vera CPU,ConnectX-9 SuperNIC和BlueField-4 DPU。机架内部通过NVLink 6纵向扩展,机架之间通过Quantum-X800 InfiniBand与Spectrum-X Ethernet横向扩展,可直接作为AI工厂模块接入。

参数上,Rubin NVL72提供3600PFLOPS NVFP4推理性能、2520PFLOPS NVFP4训练性能,配备20.7TB HBM4、1580TB/s HBM带宽和260TB/s NVLink总带宽。单颗Rubin GPU则对应50PFLOPS NVFP4推理、288GB HBM4和22TB/s HBM带宽。

这套定义强调的是机架级吞吐、内存驻留和互连密度。对长上下文模型、MoE模型和大规模推理服务来说,真正影响系统上限的是整机架内部能否形成稳定的高带宽数据路径。NVL72把GPU、CPU、网卡和DPU固定进同一系统单元,让交付形态成为可直接部署的智能生产单元。

2、Rubin GPU:HBM4、NVFP4和Transformer Engine面向推理链路

Rubin GPU的升级重点集中在HBM4、NVFP4和Transformer Engine。对应到当前模型演进,核心问题已经落在内存容量、内存带宽、低比特执行效率和上下文处理能力上。

单颗Rubin GPU配备288GB HBM4,带宽达到22TB/s。HBM容量关系到模型参数、激活和KV cache的驻留规模,HBM带宽决定长上下文推理、检索增强和多轮Agentic交互中的数据访问效率。

NVFP4已经写进推理和训练的显式规格,说明低精度路径进入主战能力范围。配合Transformer Engine、张量核心和软件栈,目标是继续压低单位token的计算成本,在可接受精度下换取更高吞吐和更低推理成本。

从Hopper的FP8,到Blackwell,再到Rubin的NVFP4,NVIDIA的路线已经很明确——就是要把低比特精度、张量核心和内存路径整合起来,服务推理、Agentic AI和长上下文推理等负载。

3、Vera CPU:承担Agentic系统的控制与调度

Vera CPU面向Agentic AI和强化学习设计,采用88个Olympus核心,通过NVLink-C2C提供1.8TB/s一致性互连带宽,并针对数据移动、Agentic reasoning和确定性性能做优化。

这类设计对应的是AI系统运行方式的变化。今天的Agentic系统除了前向推理,还包含工具调用、文件访问、状态维护、任务拆解、浏览器操作、环境交互、并发调度和强化学习rollout。CPU要持续处理控制流和系统级调度,地位已经接近控制面处理器。

88个核心面向大规模并发控制,1.8TB/s NVLink-C2C则把CPU与GPU之间的数据交换拉进更高带宽、更低延迟的一致性结构。这对于Agentic runtime、数据预处理和强化学习循环来说,这种互连方式直接关系到状态共享和执行效率。

4、ConnectX-9 SuperNIC与BlueField-4 DPU:网络和数据平面进入主执行链路

ConnectX-9 SuperNIC和BlueField-4 DPU直接纳入芯片层定义,说明网络和数据平面已经进入了主执行链路。

ConnectX-9 SuperNIC为每颗GPU提供1.6Tb/s带宽,并支持可编程RDMA和低时延GPU 直连网络(GPU-direct networking)。对分布式训练和推理来说,这关系到GPU间通信、远端存储访问、参数交换和跨节点KV cache同步的效率,最终会直接反馈到token时延和系统利用率。

BlueField-4 DPU则负责把存储、网络、安全、弹性扩展等数据处理负载从CPU和GPU主路径中卸载出来,并承接访问控制、租户隔离、DMA管理、协议栈处理和数据路径优化。

5、Groq 3 LPU/LPX:补齐低时延推理区间

Rubin产品体系里另一个值得注意的变化,是新纳入了Groq 3 LPU与Groq 3 LPX rack。其定义是为面向低时延、长上下文Agentic systems的推理加速器。

性能上看,单机架256个LPU、128GB SRAM、40PB/s memory bandwidth和640TB/s scale-up bandwidth,并能与Vera Rubin NVL72的协同设计。

这意味着整个体系开始覆盖两类推理区间。一类由Rubin NVL72承接,面向高吞吐、大容量、长上下文和大模型主体负载;另一类由Groq 3 LPX承接,面向更强调响应时间的低时延推理链路。

两类处理器对应不同目标。Rubin更重视大规模并行、超大内存容量和机架级互连;Groq 3 LPX更强调高带宽SRAM、确定性执行路径和局部数据流控制。

将其放进AI工厂后,底层算力系统就能按高吞吐、低时延、长上下文和控制调度等不同任务分工协同。

04 基础设施层:把算力拼装成“AI工厂”

如果说上一层解决的是“AI工厂由哪些芯片构成”,那么基础设施层要解决的,就是这些芯片怎样被组织起来,真正变成一套能够持续运行的工厂级机器。

按照老黄“五层蛋糕”的说法,芯片只是把能源转成智能的核心部件,但要把这种转换稳定放大到大规模推理、长上下文处理和Agentic系统运行,光有GPU、CPU和DPU还不够,必须再往上搭起互连、网络、存储和安全组成的基础设施底盘。

沿着这个思路往下看,基础设施层的几项更新其实都指向同一个目标——在更大的系统尺度上形成统一计算体。这一点也体现在具体的产品更新上。

1、NVLink 6把机架内互连变成统一的“主干”

首先被推到最核心位置的,是NVLink 6。、每颗Rubin GPU具备3.6TB/s的all-to-all scale-up带宽,Vera Rubin NVL72整机架总NVLink带宽达到260TB/s。放在平台定义里,这是在为机架内部建立一套统一的高速计算骨架。

这一点和前面的芯片层是连在一起的。既然Vera Rubin NVL72已经把72颗Rubin GPU、36颗Vera CPU、ConnectX-9 SuperNIC和BlueField-4 DPU固定成一个机架级系统,那么接下来真正决定这套系统是否成立的,就是机架内部能否维持一个足够大、足够稳定的低时延高带宽scale-up域。

对长上下文模型、MoE模型和多阶段推理来说,系统上限往往首先撞上的就是这层互连能力。因此NVLink 6在Rubin这一代承担的角色,更接近机架内主干,而不是普通意义上的芯片间连接。至于机架之间的继续扩展,则由Quantum-X800 InfiniBand和Spectrum-X Ethernet去完成。

2、Spectrum-6 SPX与Spectrum-X Ethernet Photonics:网络扩展开始拼能效和韧性

再往外一层,基础设施层要解决的,是这些机架级计算单元怎样以更低损耗、更高韧性的方式继续向外扩展,最终拼成更大的AI工厂。

这背后的工业逻辑很直接。AI工厂规模一旦继续放大,瓶颈很快就会从单颗芯片性能,转移到机架到机架之间的网络系统本身,包括交换侧功耗、光模块功耗、布线复杂度、故障率、维护可达性,以及整套网络的TCO。

在这一层,Spectrum-6 SPX Ethernet rack 承担的是机架级网络交付单元的角色,负责 AI 工厂内部大规模 east-west 流量的低时延、高吞吐互连,其可配置为基于Spectrum-X Ethernet、Quantum-X800 InfiniBand交换体系。与此同时,Spectrum-X Ethernet Photonics 进一步把共封装光学引入交换侧,用来提升光互连的能效和网络韧性。

3、BlueField-4 STX把存储拉进推理主链路

当机架内部互连和机架外部网络都进入平台后,基础设施层接下来的变化就落到了存储上。

GTC 2026里一个非常重要的更新,就是BlueField-4 STX。这是面向AI-native data platform的模块化参考架构,用来帮助企业、云厂商和AI服务商部署加速存储基础设施,支撑Agentic AI所需要的长上下文推理。

基于这套架构的新一代推理存储平台可实现最高5倍token吞吐、最高4倍能效,以及2倍更快的数据摄取;首批采用方包括CoreWeave、Crusoe、IREN、Lambda、Mistral AI、Nebius、OCI和Vultr。

当前模型演进越来越强调长上下文、Agent执行、多工具调用和检索增强,这意味着系统压力不只落在HBM和NVLink,也会落到上下文持久化、向量检索、日志与轨迹存储、知识库访问以及大规模非结构化数据吞吐上。

而芯片层解决的是“算得动”,到了这一层还要继续解决“喂得上”。

4、Confidential Computing把安全“焊”进基础设施底盘

在互连、网络和存储之外,Rubin基础设施层最后补上的,是安全边界。

这个问题在大模型时代尤其敏感。

模型权重、微调结果、私有数据和Agentic执行日志,本身都是高价值资产,云上多租、主权部署、行业隔离部署和本地部署又都在增长。

而没有硬件级机密计算,很多受监管行业和高安全要求场景都很难真正把AI系统放进生产环境。

所以,Confidential Computing放到基础设施层里,是在告诉企业可以在有隔离、有边界要求的环境里运行。

05 模型层:开放生态+ Agentic、Physical与Healthcare三向扩展

到了模型层,值得注意的是NVIDIA正式推出了Nemotron Coalition。这是由开放模型构建者与AI开发者组成的全球协作体系,通过共享研究、专业知识、数据与算力,推进open frontier models。

首批成员包括 Black Forest Labs、Cursor、LangChain、Mistral AI、Perplexity、Reflection AI、Sarvam 和 Thinking Machines Lab。

这件事的意义,更像是在在搭建开放生态,把不同区域、不同模态、不同垂直领域的模型家族继续往外长,而这些模型继续增长时,底层锚定在NVIDIA的算力与运行时体系上,其中包括DGX Cloud、CUDA、TensorRT、NIM。

开放模型越强,私有部署、行业定制和主权AI的需求就越强,下层GPU、网络、存储与运行时的需求也会被同步放大。Nemotron Coalition本质上承担的是“把开放模型繁荣,转化成基础设施投资”的机制。

另外NVIDIA还扩展了开放模型家族,方向集中在Agentic AI、physical AI 和 healthcare AI。

Agentic一侧包括CodeRabbit、CrowdStrike、Cursor、Factory、ServiceNow、Perplexity;;physical AI一侧包括 LG Electronics 和 Milestone Systems;healthcare一侧则包括Novo Nordisk、Viva Biotech 和 Manifold Bio。

06 应用层:把AI能力兑现为生产力

放在“五层蛋糕”的框架里看,NVIDIA把应用层定义成 AI工业体系里最接近真实生产力的一层。能源、芯片、网络、基础设施决定的是上限,真正把这些能力变成行业效率、企业ROI 和可持续采购理由的,还是应用层。

也正因为如此,老黄在GTC上反复强调CUDA-X是NVIDIA的crown jewels。沿着这条线看,GTC 2026的应用层至少释放了两个很强的信号。

第一个信号,是结构化与非结构化数据处理,已经被NVIDIA明确纳入AI时代的基础能力。老黄在演讲里把SQL、Spark、Pandas、Velox、Snowflake、Databricks、BigQuery、Fabric、EMR放进同一张图,强调结构化数据正在为AI提供上下文,并特别点出cuDF和cuVS的平台价值。

这个信息很重要,说明NVIDIA对企业AI的理解进一步推进到了数据处理、向量检索和RAG数据平面这一层。

这背后的行业判断是,企业AI一旦从试点走向长期运行,成本结构很快就会发生变化。决定系统能否落地的,是企业内部大量表格、日志、PDF、视频、语音等数据,能否被快速整理、索引、检索并转成模型可消费的上下文。

也就是说没,谁能把这一层做到高吞吐、低时延、低成本,谁就能在企业AI的生产阶段占住关键位置。CUDA-X的价值也正在这里体现出来,其可将算力折算成查询时间、索引效率、检索速度和整体成本的结果。

第二个信号,是Agentic AI开始拥有独立的运行能力。Agent正在从模型外的一层“交互封装”,演进为可部署、可管理、可扩展的系统对象。

在GTC 2026上,这条线最核心的更新来自Dynamo 1.0、OpenClaw、NemoClaw和OpenShell。NVIDIA将Dynamo 1.0定义为面向大规模生成式与Agentic推理的开源操作系统,这一定位的关键在于——把推理调度、并发执行、上下文管理、跨硬件协同以及工厂级运行,整合进一层更高阶的系统软件中。

与此同时,NemoClaw与OpenShell补齐了执行侧的另一半能力。OpenShell对应运行环境,OpenClaw对应Agent框架,NemoClaw则负责模型接入、隐私与安全控制。

当这几层被串联起来之后,Agent就不再只是调用模型API、拼接工具链的轻量封装,而开始具备长生命周期、本地执行环境以及清晰的安全边界,逐渐成为真正意义上的“系统单元”。

应用层的另一部分变化,体现在图形技术与本地AI的结合上。DLSS 5、RTX PC、DGX Spark、DGX Station放回NVIDIA的方法论中,本质就是应用层如何向本地环境分布。

以DLSS 5为例,其把“NVIDIA式的可控生成”具象化地展示出来——由确定性的3D结构提供边界,再由生成模型补充光照、材质和细节。这种“结构约束+生成补全”的范式,并不仅仅属于图形渲染,在工业仿真、数字孪生、机器人训练以及物理AI数据生成中,同样可以复用,结构负责确定边界,生成负责填充复杂性。

而RTX PC、DGX Spark、DGX Station的意义,则在于把Agent和开放模型的运行层,从数据中心拉回到个人设备与工作站中。

NVIDIA在这次GTC上明确强调,OpenClaw及相关开放模型已经可以在RTX PC、DGX Spark等系统上本地运行。这意味着,未来的应用层不会只存在于云端API之上,而是会分布在个人终端、企业私有环境以及本地工作流之中。对于涉及隐私、权限控制、低时延以及持续交互的任务来说,本地运行本身就是应用能力的一部分。

再往下延展,Physical AI其实可以被视为应用层的外延。在GTC 2026中,Isaac、Cosmos、GR00T,以及Open Physical AI Data Factory Blueprint的更新,显示出NVIDIA正在将机器人与自动驾驶相关的软件栈,重组为一条完整的“生产链”。

在这一体系中,覆盖了世界模型、仿真框架、机器人基础模型、数据生成与评估的一整套系统能力。机器人场景对应用层的要求更高,因为它必须同时承接模型、数据、仿真、控制以及边缘部署。

也正因如此,Physical AI成为NVIDIA全栈协同能力最集中的落点之一。

汽车与工业软件方向同样遵循这一逻辑。CUDA-X、Omniverse、DRIVE、Hyperion等产品,开始更完整地嵌入设计、仿真、验证、训练到部署的全流程。

对于车厂和制造业企业来说,应用层真正需要的,是一条从研发到执行的连续加速链,而不是若干彼此割裂的软件工具。

本文内容由互联网用户自发贡献,该文观点仅代表作者本人。如发现本站有涉嫌抄袭侵权/违法违规的内容,请发送邮件至 203304862@qq.com

本文链接:https://jinnalai.com/jiaodian/817403.html